کارشناس بلاک چین و هوش مصنوعی آیبیام میگوید ChatGPT چندین «خطر کلیدی» برای استفاده سازمانی دارد

جری کومو از IBM Automation با فهرست کردن زمینههای نگرانکننده، مشکلات بالقوه کسبوکارهایی را که از ChatGPT استفاده میکنند، بیان میکند.

جری کومو، مدیر ارشد فناوری IBM Automation اخیراً یک پست وبلاگی منتشر کرده است که به ادعای او چندین خطر مرتبط با استفاده از ChatGPT برای سازمانی است.

طبق پست وبلاگ، چندین حوزه خطر کلیدی وجود دارد که مشاغل باید قبل از اجرای ChatGPT در نظر بگیرند. با این حال، در نهایت، Cuomo نتیجه می گیرد که تنها داده های غیر حساس با ChatGPT ایمن هستند:

Cuomo مینویسد: «وقتی دادههای شما وارد ChatGPT میشود، شما هیچ کنترل یا دانشی در مورد نحوه استفاده از آن ندارید.»

بر اساس این پست، اگر دادههای شریک، مشتری یا مشتری پس از افشای دادههای آموزشی ChatGPT در معرض دید عموم قرار گیرد، این نوع نشت دادههای ناخواسته میتواند از نظر قانونی، کسبوکارها را در معرض خطر قرار دهد.

کومو در ادامه به خطراتی برای مالکیت معنوی و این احتمال اشاره میکند که نشت میتواند کسبوکارها را در نقض قراردادهای منبع باز قرار دهد.

طبق پست وبلاگ IBM:

“اگر اطلاعات حساس شخص ثالث یا شرکت داخلی در ChatGPT وارد شود، بخشی از مدل داده ربات چت می شود و ممکن است با دیگرانی که سوالات مرتبط می پرسند به اشتراک گذاشته شود.”

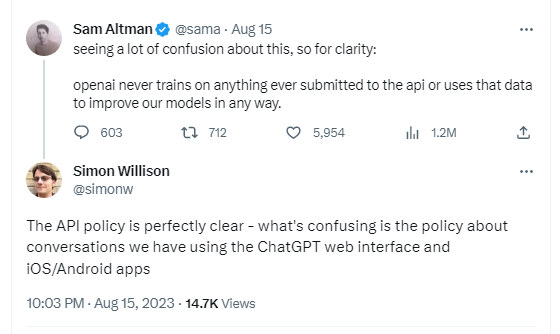

یگ رسانه برای اظهار نظر در مورد بیانیه بالا با OpenAI تماس گرفت و پاسخ زیر را از یک واسطه روابط عمومی از طریق ایمیل دریافت کرد: “[این] داده ها با دیگرانی که سوالات مرتبط می پرسند به اشتراک گذاشته نخواهد شد.”

این نماینده همچنین به اسناد موجود در مورد ویژگیهای حریم خصوصی ChatGPT، از جمله یک پست وبلاگ که جزئیات توانایی کاربران وب برای خاموش کردن سابقه چت خود را توضیح میدهد ، اشاره کرد .

به گفته OpenAI، ChatGPT API به طور پیش فرض به اشتراک گذاری داده خاموش است.

با این حال، منتقدان اشاره کرده اند که مکالمات در نسخه وب به طور پیش فرض ذخیره می شوند. کاربران همچنین باید از ذخیره مکالمات خود انصراف دهند – یک ویژگی راحت برای ادامه دادن از جایی که متوقف شدند – و استفاده از داده های آنها برای آموزش مدل. در حال حاضر هیچ گزینه ای برای حفظ مکالمات بدون موافقت با اشتراک گذاری داده ها وجود ندارد.